Dans un projet web, l’IA générative peut accélérer la production de contenus, de maquettes, de code ou même de workflows SEO. Mais plus l’automatisation monte en puissance, plus la question devient stratégique : où gagner du temps sans perdre en qualité, en sécurité, en conformité… et en résultats business (visibilité Google, leads qualifiés, conversions e‑commerce) ?

Pour une PME ou un e‑commerçant, le bon choix n’est presque jamais “tout automatique” ou “tout manuel”. Il s’agit plutôt de définir une approche hybride : ce que l’on confie à la génération automatique, ce que l’on verrouille par des garde-fous (tests, validation, traçabilité), et ce qui doit rester sous contrôle humain, notamment à la lumière des exigences européennes (AI Act) et des retours récents sur la qualité/sécurité du code généré.

1) Automatiser, oui, mais pour quel objectif mesurable ?

Avant de choisir une approche, clarifiez l’objectif principal : accélérer la mise en ligne, réduire le coût de maintenance, augmenter le trafic organique, améliorer le taux de conversion, ou industrialiser la création de pages. Sans KPI, l’automatisation risque de produire “plus” (plus de pages, plus de code) sans produire “mieux” (plus de commandes, plus de formulaires, plus de positions Google).

Les études sur l’assistance au développement montrent des gains réels mais généralement modestes et variables selon le contexte. Par exemple, une étude (arXiv, 02/10/2024) observe une hausse de productivité d’environ +6,5% en open-source (méthode “synthetic control”). D’autres travaux plus récents (arXiv, 24/09/2025) nuancent les gains perçus versus mesurés : l’outil aide, mais ne remplace pas une méthode de delivery ni une discipline d’ingénierie.

Dans une agence orientée résultats (SEO, performance, conversions), l’IA est pertinente si elle sert un pipeline clair : brief → production → validation → mise en ligne → mesure. L’enjeu n’est pas seulement de “générer”, mais de garder la maîtrise : cohérence de marque, conformité, accessibilité, performance web, et impact sur la visibilité.

2) Le risque de “qualité apparente” : quand l’IA produit du code crédible mais vulnérable

Le principal piège côté génération de code est l’illusion de robustesse : le code “a l’air” propre, compile, passe parfois des tests basiques… tout en introduisant des failles. Le rapport Veracode “2025 GenAI Code Security Report” (juil. 2025), basé sur 80 tâches “curated” et plus de 100 LLMs (Java, Python, C#, JavaScript), indique qu’environ 45% des échantillons générés échouent des tests de sécurité et peuvent introduire des vulnérabilités proches de l’OWASP Top 10. Ce chiffre a été largement repris (01/08/2025), justement pour alerter sur le caractère “production-ready” trompeur.

Dans le web, ces vulnérabilités ne sont pas théoriques : injection, contrôle d’accès insuffisant, mauvaise gestion des sessions, exposition de secrets, désérialisation, SSRF… Une seule erreur sur une fonctionnalité critique (checkout WooCommerce, back-office, espace client, synchronisation ERP/CRM) peut coûter plus cher que le temps “économisé” au départ.

La conséquence pratique est simple : si vous utilisez la génération automatique pour accélérer le dev, vous devez renforcer le contrôle humain et les garde-fous AppSec (revue de code structurée, CI avec SAST/DAST, dépendances, secrets scanning). Les chiffres récents rapportés côté marché vont dans le même sens : un “State of AI in Security & Development” (23/10/2025) mentionne que 69% des organisations auraient déjà trouvé des vulnérabilités dans du code généré par IA, ce qui milite pour une gouvernance plus stricte (tout en restant prudent sur la méthodologie de ces statistiques).

3) Sécurité et IA : penser aussi les risques spécifiques aux LLM (pas seulement au code)

Quand votre projet web intègre des fonctionnalités IA (chat support, recherche sémantique, RAG sur catalogue, agent qui crée des tickets, génération de descriptions produits), les risques dépassent l’OWASP “classique”. L’OWASP Top 10 for LLM Applications (v2.0, 2025) structure des menaces comme la prompt injection, la fuite de données (data leakage), l’empoisonnement de données, ou les permissions excessives via outils/agents.

Ces risques sont particulièrement concrets dès qu’un modèle a accès à des actions : écrire dans un CMS, appliquer une remise, déclencher un email, modifier un stock, ou interroger des sources internes. Des travaux sur les menaces liées à l’“agentic AI” (avr. 2025, arXiv) soulignent justement la dangerosité potentielle d’agents qui agissent avec une supervision faible. Cela ne signifie pas “ne pas le faire”, mais concevoir des barrières : permissions minimales, validation humaine pour les actions sensibles, journaux d’audit, sandboxing, et tests d’attaque (red teaming).

À l’échelle d’une PME, une approche pragmatique est de classer les cas d’usage : “assistants” (suggestion de texte) vs “acteurs” (exécution d’actions). Plus on s’approche d’un acteur, plus on doit exiger un humain “in the loop” et des contrôles techniques (limites, règles, monitoring), afin de réduire la probabilité et l’impact d’un comportement inattendu.

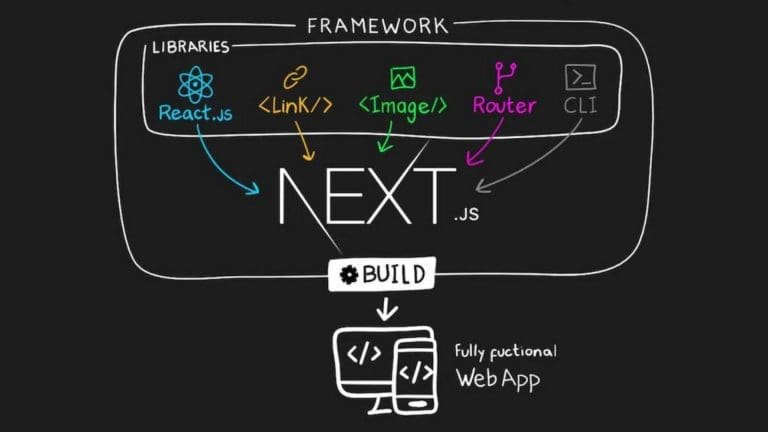

4) Dette technique : la vitesse d’aujourd’hui peut coûter cher demain

Les décisions d’automatisation ne se jugent pas uniquement au temps gagné cette semaine, mais au coût de maintenance sur 12 à 24 mois. Une analyse GitClear (déc. 2024) sur 211 millions de lignes de changements (2020,2024) met en avant des signaux de dégradation de certaines métriques de “code quality” dans des pratiques où l’assistance IA est présente, une conclusion reprise et vulgarisée par TechCrunch (21/02/2025) avec l’idée que “les assistants de code IA ne sont pas une panacée”.

Dans un projet web, la dette technique se traduit vite par : corrections qui cassent autre chose, temps de review plus long, déploiements plus risqués, performances instables, SEO technique qui se dégrade (Core Web Vitals, duplication, templates incohérents), et coûts de refonte plus précoces.

Un signal opérationnel important : une enquête rapportée (09/01/2026) indique que “près de la moitié” des développeurs ne vérifient pas le code généré par IA, et que 38% estiment que la revue prend plus de temps qu’avec du code de collègues. Autrement dit, l’IA peut déplacer l’effort : moins de saisie, plus de contrôle. L’approche gagnante consiste à standardiser (conventions, linters, tests, architecture) pour que la review reste rapide et utile.

5) Conformité UE : l’AI Act pousse vers une IA “human-centric” et la supervision humaine

Au-delà de la technique, il y a la conformité. L’Union européenne insiste sur une IA “human-centric” dans l’AI Act (13/03/2024, plein effet mi‑2026), avec l’idée que les humains doivent rester en contrôle, particulièrement pour les systèmes à risque élevé. Une analyse IAPP (12/06/2024) résume bien l’esprit : “both the human in the loop and the humanity in the loop”, ce qui dépasse la simple validation technique pour inclure des considérations de responsabilité et d’impact.

Plus récemment, (02/08/2026) l’AI Act est rappelé sous l’angle des obligations de supervision humaine (“human oversight”) et du calendrier d’entrée en application, un point très concret pour décider quand garder un humain dans la boucle sur des fonctionnalités web sensibles : scoring, modération, recommandation, tri de candidats, décisions tarifaires, détection de fraude, ou tout système pouvant impacter fortement un utilisateur.

Enfin, un code de pratique UE volontaire (10/07/2025) vise à aider les entreprises à se conformer : transparence, copyright, sûreté/sécurité. Pour un site e‑commerce ou vitrine, cela implique de documenter les usages (qu’est-ce qui est généré, par quel modèle, avec quelles données), de sécuriser les prompts et les accès, et d’être clair sur les contenus (notamment si l’IA influence la relation commerciale).

6) Une grille de décision simple : où automatiser, où imposer du contrôle humain

Pour choisir la bonne approche, segmentez votre projet en “zones” selon le risque : (1) faible risque et réversible, (2) moyen risque, (3) risque élevé et/ou impact client direct. La génération automatique convient très bien à la zone (1) : brouillons de contenus, variantes de micro‑copy, scripts internes non critiques, prototypes UI, ou tâches répétitives.

En zone (2), adoptez un modèle “copilote” : l’IA propose, l’humain arbitre, et la CI vérifie. Typiquement : templates WordPress/WooCommerce, refactoring, création de pages SEO à partir d’un plan éditorial, ou migration de contenus. Le contrôle humain est là pour la cohérence de marque, l’accessibilité, la conformité RGPD, et la qualité SEO (intention de recherche, maillage interne, cannibalisation, E‑E‑A‑T).

En zone (3), gardez systématiquement un humain “in the loop” et des garde-fous renforcés : checkout/paiement, gestion des comptes, sécurité, permissions admin, actions automatiques (agents), intégrations (ERP/CRM), ou génération de code qui touche l’authentification/autorisation. Les référentiels comme le NIST AI RMF (mai 2025) sont utiles pour formaliser une approche risques : gouvernance, mesure, monitoring continu, afin que l’automatisation reste sous contrôle dans le temps, pas seulement le jour du lancement.

7) Mettre en production sans subir : gouvernance, outils, adoption et dépendance fournisseur

Une bonne approche ne se limite pas à “activer” une fonctionnalité IA : elle se gouverne. Définissez des règles : quelles parties du code peuvent être générées, quelles règles de revue s’appliquent, quels tests sont obligatoires, et comment tracer l’origine (utile pour la conformité et la maintenance). Des retours (18/12/2025) rapportent que des PRs avec outils IA auraient plus “d’issues” en moyenne et des reviews plus longues : cela plaide pour des pipelines CI plus stricts, pas pour l’abandon de l’IA.

Pensez aussi à l’adoption interne. Un retour terrain (08/09/2025) évoque la frustration d’utilisateurs face à des fonctionnalités “imposées”. Pour une PME, imposer un outil sans option de retrait peut dégrader la qualité (contournements, désengagement). Mieux vaut une charte d’usage, des exemples de prompts validés, et des garde-fous qui aident au quotidien (snippets, checklists, PR templates), plutôt qu’un déploiement autoritaire.

Enfin, anticipez la dépendance fournisseur : des changements de modèles disponibles via des outils de type Copilot (presse, 24/10/2025) rappellent que l’écosystème évolue vite (dépréciations, changements de performance). Une stratégie robuste inclut : des tests d’évaluation reproductibles, une abstraction des appels IA, et la capacité à substituer un modèle si nécessaire, tout en gardant le contrôle humain sur les parties critiques.

Choisir entre génération automatique et contrôle humain, ce n’est pas arbitrer “innovation versus prudence”. C’est construire une chaîne de production web plus performante : l’IA pour accélérer là où le risque est faible et la valeur immédiate, l’humain pour garantir la qualité, la sécurité, la cohérence de marque et la conformité là où l’impact est fort.

Pour un site vitrine, une boutique WooCommerce ou une plateforme sur mesure, l’approche la plus rentable est souvent hybride : automatisation partielle, règles de revue et de tests renforcées, supervision humaine sur les fonctionnalités sensibles (au regard des exigences de l’AI Act), et pilotage par des indicateurs (SEO, conversion, stabilité). C’est ainsi que l’IA devient un levier de croissance mesurable, et non une source de dette ou de risque.